Sublime

An inspiration engine for ideas

the REVOLUTION STARTS with the ARTS

youtube.comsan francisco has a strange gravity, attracting people who want to build the future, and also those who want to be seen building the future. the result is a city that can feel incredibly performative, especially within the startup bubble.

a lot of “founders” aren’t actually building much. instead, they’re posting, going from one event to the other,... See more

a lot of “founders” aren’t actually building much. instead, they’re posting, going from one event to the other,... See more

You're alive in inverse proportion to the density of cliches in your writing — Nassim Taleb

My guide to conversational copywriting

Reconciling modern science with ancient esoteric worldviews by holding subjective experience and objective facts without either-or thinking

TRANSCRIPT

I have what modern science tells me, and I have my experience, which is also informed much more by – it's more supported by the ancient worldview. and I hold these two things side by side and I leave them to have their own domains of authority in my life, but I allow them to communicate with each other.

Now people call this cognitive dissonance.

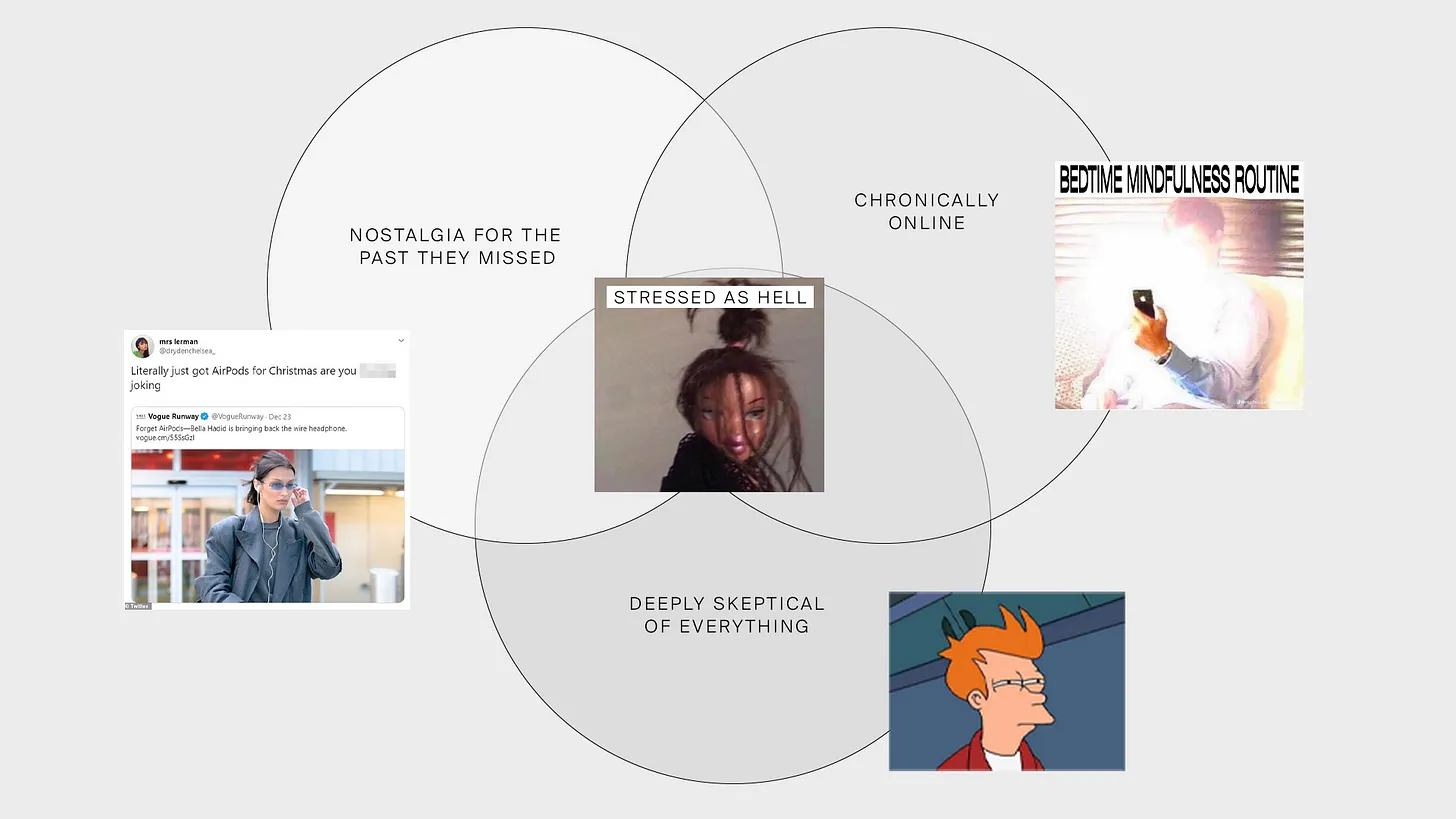

... See more“We fought the slop, and the slop became us. Or, some of us. But the slop isn’t going anywhere, and the question now is how to learn about the world online without becoming a conduit for slop. A slop creator. A slop enjoyer. Is it even possible?”

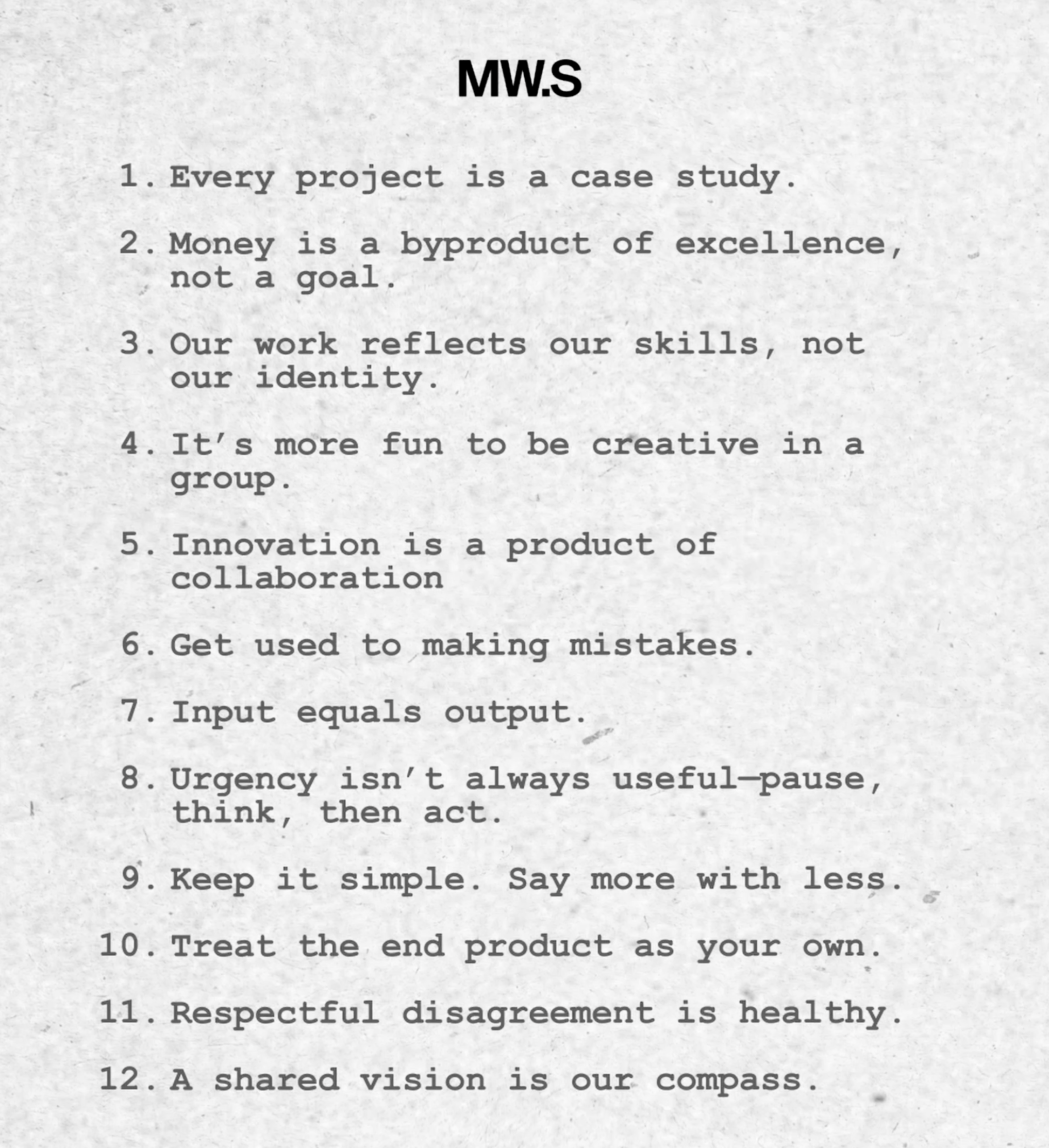

How Mouthwash Studio make creative decisions across the multi-media landscape | Alex Tan

youtube.com